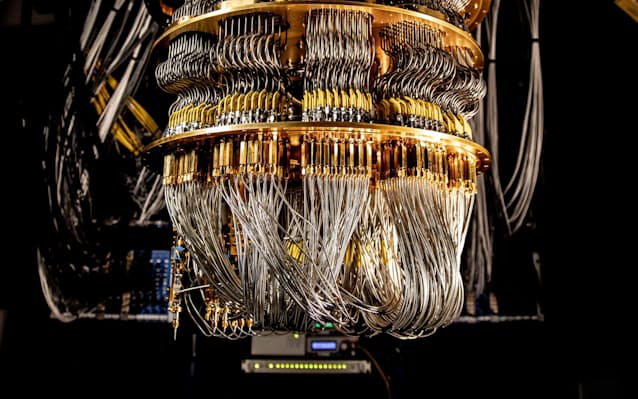

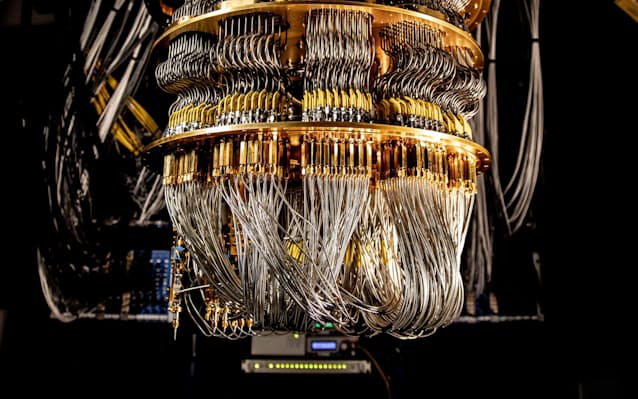

グーグルが開発を進める量子コンピューター=Google Quantum AI提供

米グーグルなどは量子コンピューターの開発で大きな障害となっている計算中のエラーを訂正する技術を改良し、計算性能の向上に役立つことを初めて実証した。

論文が9日付の英科学誌ネイチャーに掲載された。実用に向く量子コンピューターの開発につながる成果だ。

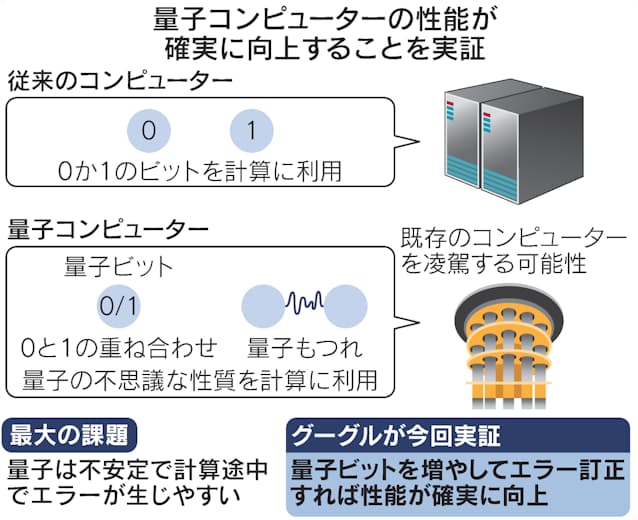

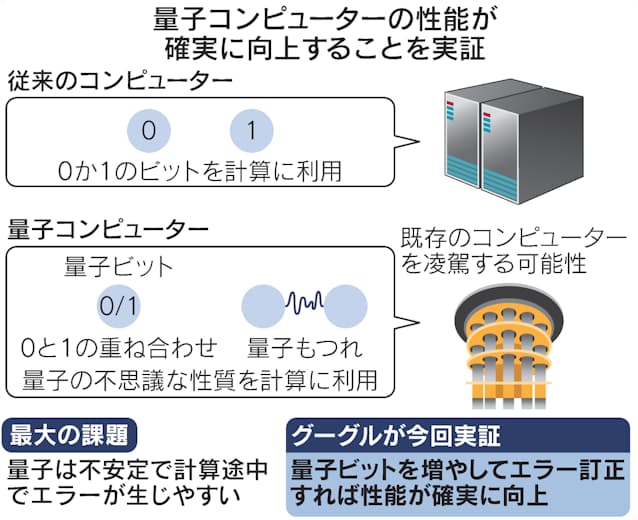

量子コンピューターは原子レベル以下の微小な世界で成り立つ量子力学という物理学の理論を利用する。

従来のコンピューターが「0」と「1」というビットを計算に使うのに対し、「0でもあり1でもある」という量子の特別な性質を利用する。

スーパーコンピューターで数十年かかる複雑な問題を数分で解けるとされ、材料開発や金融分野など多くの産業分野で実用化が期待されている。

実用に向く量子コンピューターの開発には技術的な課題がある。最も大きな課題が計算中に生じるエラーだ。

量子ビットと呼ばれる計算素子が不安定で、エラーが生じやすい。長時間動かすと、エラーが蓄積されて、不正確な結果になる。

そのため、エラーの発生を抑えたり、訂正したりする技術が必須となる。解決する手段として、複数の量子ビットを組み合わせて、エラーを検出し、訂正する技術が有力だとされてきた。

ただ、この技術で本当に性能が向上するのかが分かっていなかった。

グーグルなどは超電導方式の量子コンピューターで誤り訂正の技術を試した。72個の量子ビットと105個の量子ビットの回路を作って比較すると、量子ビットの数が多い方がエラー発生を抑えられることが確かめられた。

大阪大学の藤井啓祐教授は「量子ビットを増やすほど量子コンピューターの性能が伸びることが初めて実証された。今までは100年たってもできないとされていたが、2014年にグーグルが量子コンピューター分野に参入してから10年で成功したのは画期的だ」と評価する。グーグルは11月にも人工知能(AI)をエラー訂正に利用する手法を発表した。

世界ではこれまでに最大約1000個の量子ビットを持つ量子コンピューターが開発されているが、汎用的な計算には100万個必要だとされる。

グーグルは29年に100万個の量子ビットを使う量子コンピューターの実現を目指している。

ライバルの米IBMは16年に量子コンピューターをクラウド上で公開し、日本でも21年に川崎市に実機を設置した。29年にもエラー訂正ができる実用的な量子コンピューターの公開を目指している。

日本では富士通や理化学研究所が超電導方式の量子コンピューターの開発に取り組む。理研は23年3月に初の国産量子コンピューターを公開した。富士通は23年10月に同社として初の量子コンピューターを公開し、26年以降に1000量子ビット以上の量子コンピューターを公開する計画だ。

<picture class="picture_p166dhyf"><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=638&h=520&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=734e7c41841d2c095432a1495f8c98f6 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1276&h=1040&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=d7d9f699521c1f1ce6d006acfe057707 2x" media="(min-width: 1232px)" /><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=638&h=520&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=734e7c41841d2c095432a1495f8c98f6 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1276&h=1040&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=d7d9f699521c1f1ce6d006acfe057707 2x" media="(min-width: 992px)" /><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=600&h=489&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=5f1d1d8405cb973cbfd49d5a434b5ff3 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1200&h=978&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=414d23f5402826cbcf027acb4ea5a9aa 2x" media="(min-width: 752px)" /><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=600&h=489&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=5f1d1d8405cb973cbfd49d5a434b5ff3 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1200&h=978&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=414d23f5402826cbcf027acb4ea5a9aa 2x" media="(min-width: 316px)" /><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=600&h=489&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=5f1d1d8405cb973cbfd49d5a434b5ff3 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1200&h=978&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=414d23f5402826cbcf027acb4ea5a9aa 2x" media="(min-width: 0px)" /></picture>

<picture class="picture_p166dhyf"><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=638&h=520&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=734e7c41841d2c095432a1495f8c98f6 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1276&h=1040&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=d7d9f699521c1f1ce6d006acfe057707 2x" media="(min-width: 1232px)" /><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=638&h=520&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=734e7c41841d2c095432a1495f8c98f6 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1276&h=1040&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=d7d9f699521c1f1ce6d006acfe057707 2x" media="(min-width: 992px)" /><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=600&h=489&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=5f1d1d8405cb973cbfd49d5a434b5ff3 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1200&h=978&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=414d23f5402826cbcf027acb4ea5a9aa 2x" media="(min-width: 752px)" /><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=600&h=489&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=5f1d1d8405cb973cbfd49d5a434b5ff3 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1200&h=978&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=414d23f5402826cbcf027acb4ea5a9aa 2x" media="(min-width: 316px)" /><source srcset="https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=600&h=489&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=5f1d1d8405cb973cbfd49d5a434b5ff3 1x, https://article-image-ix.nikkei.com/https%3A%2F%2Fimgix-proxy.n8s.jp%2FDSXZQO5726235009122024000000-1.jpg?ixlib=js-3.8.0&w=1200&h=978&auto=format%2Ccompress&fit=crop&bg=FFFFFF&s=414d23f5402826cbcf027acb4ea5a9aa 2x" media="(min-width: 0px)" /></picture>

量子コンピューターへの期待は大きい。米ボストン・コンサルティング・グループは40年までに世界全体で最大8500億ドル(約128兆円)の経済価値を生み出すと予測する。

量子コンピューターを使えば、高性能な電池材料や、環境に優しい触媒の開発などが早くなるとされる。また金融工学のような複雑なシミュレーションが必要な分野でも活用が期待される。

ひとこと解説

量子コンピューターが実用化されると素因数分解や離散対数問題といった暗号の基礎となるアルゴリズムを解読されるリスクがあることから、世界のセキュリティ研究者は量子コンピューターの性能向上に対して、固唾を呑んで見守っています。

一方で量子計算による暗号解読を実用化するには、量子ビットを増やすことに加えて、安定して動作するコヒーレンス時間を延ばす必要があります。

とはいえ危殆化した暗号アルゴリズムを安全なものに置き換えるには、耐量子暗号アルゴリズムの実用化や製品開発、システム対応、証明書の交換などに十年以上の時間を要することから、各国とも最新の開発状況を注視しつつ、移行計画を検討しているところです。

<button class="container_cvv0zb2" data-comment-reaction="true" data-comment-id="48518" data-rn-track="think-article-good-button" data-rn-track-value="{"comment_id":48518,"expert_id":"EVP01084","order":1}">

7

7</button>