筆者は、これまで米国各州の包括的個人情報保護立法につき解説してきた。例えば、最も厳しいとされるカルフォルニア州 、同州、オハイオ州、コロラド州につき取り上げてきた。

4月初め、ケンタッキー州議会は包括的なプライバシー法(H.B.15)(以下、「法律」という)を可決した。この法律は4月4日に州知事が署名し、成立、この法律は 2026 年 1 月 1 日に発効する。

今回のブログ投稿では、この法律の重要な要点を要約する。これにより、カリフォルニア、バージニア、コロラド、コネチカット、ユタ、アイオワ、インディアナ、テネシー、モンタナ、オレゴン、テキサス、フロリダ、デラウェア、ニュージャージー、ニューハンプシャー州の立法に加わる。 (計16州)

また筆者が注目するのは英国や米国州の最近時の立法傾向は「正確な地理位置情報データ(precise geolocation data)」や「13歳未満の児童の個人情報」(注1)を機微情報としている点である。また、従来から国際スタンダードとして立法上明記されている「データ保護影響評価 (DPIA)」の重要性や義務化問題もある。

一方で、わが国の法改正の経緯を見ると欧米のような経緯をたどっているようには見えない。今回のブログはこれら問題につき詳細に論じる。

Ⅰ.ケンタッキー州の包括的情報保護法の概要

Covington & Burling LLP.の以下の弁護士が執筆したブログを仮訳する。

Lindsey Tonsager 氏

Libbie Canter氏

Hensey A. Fenton III 氏

Samar Amidi 氏

■法律の適用範囲: この法律は、ケンタッキー州で事業を行うか、ケンタッキー州住民を対象とした製品やサービスを生産する暦年中に、(i) 少なくとも 100,000 人の消費者の個人データを管理または処理する、または (ii) 少なくとも 25,000 人の消費者のデータを管理または処理し、総収益の 50% 以上を個人データの販売から得る管理者および処理者に適用される。

■消費者の権利: この法律は、とりわけ、消費者にアクセス、削除、携帯性・移植性、および修正の権利を付与する。 同法により、消費者は、(1)ターゲットを絞った広告、(2)個人データの販売、(3)法的または同様の重要な効果を生み出す意思決定を促進するプロファイリングを「オプト・アウト」することも可能となる。

■機密データ(Sensitive Data)について事前同意義務: 管理者(controllers)は、消費者の機密データを処理する前に同意を得る必要がある。 同法では、機密データを、(1)人種または民族的出身、(2)宗教的信念、(3)精神的または身体的健康状態、(4)性的指向、(5)市民権または永住権保持・在留資格(immigration status)(注2)を示す個人データ、(6)固有の個人を識別するために処理された遺伝子(genetic)データまたは生体認証データ、(7)収集された既知の子ども情報(注2-2)および「正確な地理位置情報データ(precise geolocation data)」(注3)を「機密データ」と定義している。

■データ保護影響評価 (DPIA)の義務付け: この法律は、(1)ターゲットを絞った広告、(2)個人データの販売、(3) 限られた状況でのプロファイリング、(3)機密データの処理、または(4)その他の消費者への危害リスクの増大を伴う活動の処理に対して、データ保護影響評価 (DPIA) を義務付ける。

執行: ケンタッキー州司法長官は、この法律を執行する独占的な権限を有する。 この法律はまた、管理者と処理者に、日没しない30日間の治療権を与えることになる。

Ⅱ.米国各州の包括的情報保護法のおける「機微情報」をめぐる特徴的な点やわが国の今後の保護法立法や法改正のあり方を巡る課題

1. 子供特に 13 歳未満等の児童の個人情報の機微情報の明確な規定化

(1)米国の新しい州の「包括的な」プライバシー法には、子供に適用される規定がある。 たとえば、カリフォルニア州では、子供が 13 歳未満であることを実際に知っている企業は、連邦法である1998年COPPA(Children's Online Privacy Protection Act) の同意要件に加えて、その子供のデータを販売または共有する場合は親の同意を得る必要がある。 13 歳から 16 歳までの子どもの場合、カリフォルニア州法に基づき、企業は子どもの情報の販売または共有について子どもの「同意」を得る必要がある。 他の州では、子供の情報を「機密情報(sensitive data)」と定義している。 そしてこれらの法律に基づき、企業は機密情報を第三者と共有する場合、消費者(未成年者の場合はその親)に通知しなければならない。 また、場合によっては、機密情報を処理する前に「データ保護影響評価(DPIA)」を実施する必要がある。

(2)次に、カリフォルニア州が、英国の児童保護規範 (Children's Code:年齢確認に基づく保護規範)(筆者ブログ参照)をモデルとした「カリフォルニア州年齢適正設計法:The California Age-Appropriate Design Code Act)」 を2022年11月に可決した。(解説例参照) この法律は2024年7月1日に施行される予定で、「子供がアクセスする可能性がある」オンライン製品、サービス、機能を提供する企業(つまり18歳未満の子供)に適用される予定である。 ただし、この法律は 裁判結果もあり2023 年末に一時的に禁止された。この法律が予定どおり発効した場合、企業は以下の行為を禁止される。

①「ダーク・パターン」(注4)を使用する。

②「子どもにとって重大な害を及ぼす」行為。

③子どもたち情報の自動プロファイリング。(注5)

さらに、企業は(やむを得ない理由がない限り)子供の地理位置情報を収集することはできず、サービスの提供に必要な個人情報のみの収集に限定される。 さらに、通知と条件は年齢に応じた言葉で提供される必要がある。 最後に、企業は子供が利用できるサービスを提供する前に、データ保護影響評価(DPIA)を実施する必要がある。

(3)学生のプライバシー保護

連邦レベルで「家族の教育の権利とプライバシーに関する法律 (Family Educational Rights and Privacy Act :FERPA 」と米国の州の約半分の両方で、学生のプライバシーに対処する法律がある。 これらの法律の主な焦点は、学校が生徒からどのような情報を収集できるかということである。 ただし、学校のビジネス パートナーが生徒とどのようにやり取りできるかにも影響を与える。 たとえば、州法に基づき、学校のビジネス パートナーは、生徒の個人情報を不正なアクセス、使用、破壊、開示から保護する必要がある。 また、学校から要請があった場合には、生徒情報を削除しなければならない。

(4)ソーシャルメディア・プラットフォームを対象とした新しい米国の州立法の動向に留意

心に留めておく価値があるのは、ソーシャルメディア・プラットフォームを対象とした新しい米国の州立法である。 これらの法律はこれまでにアーカンソー州、モンタナ州、オハイオ州、テキサス州、ユタ州で可決された。 しかし、発効予定だったすべての法律は延期されており、合衆国憲法修正第 1 条の言論の自由を理由に州の法律は違憲であるという難題に悩まされている。 一般に、これらの法律では、アカウントを作成する際に個人に年齢の提供を義務付け、アカウントが完成する前に子供の親の同意が必要となる。 また、プラットフォームが子供から収集できる情報の量や、子供がアクセスできる広告の種類も制限されることになる。

2.米国でビジネスを行っており、子供たちから情報を収集する場合、現在施行されている法律、および今後施行される法律に備えるためにどのような手順を踏むことが必要か?

(1) 親や保護者の同意

13 歳未満のユーザーから個人情報をオンラインで収集する場合は「同意」が必要であることに注意すべきである。この要件は 1998 年COPPAから存在する。その間に「オンライン」は変化した可能性があり、「個人情報」に対する我々の理解も広がった。 オンライン・ プラットフォームにはモバイル・ アプリが含まれており、インタラクティブなおもちゃも含まれる場合があることに注意されたい。 また、個人情報は単なる名前や電子メール・ アドレスだけでなく、画像や音声に加え、連邦取引委員会(FTC) によれば永続的な識別子も含まれる。

(2) データ最小化の原則の検討

法律で子供から収集するものを最小限に抑えることが特に義務付けられていない場合でも (ただし、そうしている人が多いことに注意されたい)、データが多ければ多いほど、保護する必要があるものも増える。 現時点では、COPPA は、該当する場合、収集できる内容を「サービスまたは機能を提供するために必要なもの」に制限しており、新しい州法も同様である。

(3)収集行為が「暗いパターン」に該当するかどうかを評価する

FTC は、EUのデータ保護委員会(EDPB) と同様に、消費者をだまして、誤解を与えて、通常よりも多くの情報を提供させることに懸念を表明している。 あるいは、もっと反省していれば同意しなかったであろう方法で自分の情報が使用されることに同意することを重要視している。 こうしたアクティビティは「ダーク ・パターン」と呼ばれ、FTC はさまざまな推奨事項の中で、ユーザーの観点からプログラムをテストすることを提案している。 子供の場合、これには子供だけでなく、COPPA の目的で同意を与える親も含まれる可能性がある。

(4)子供への危害の概念に留意する

規制当局が特に懸念しているのは、子供に危害を及ぼす可能性のある活動である。 規制当局からの明確な指示がない場合、またはこれらの法律に基づく判例が存在しない場合、企業は規制当局が自社のプラットフォームについてどう考えているのか疑問を持つ可能性がある。 たとえば、それが子供を搾取していると誰かが主張できるか? 子どもが関与する活動に対して、どのような対抗措置や利益が存在するか? 潜在的な危害を最小限に抑えるためにどのような措置が講じられているか? 言い換えれば、GDPR データ保護影響評価を実施するときに通過する思考プロセスに参加されたい。

3. 「正確な地理位置情報データ(precise geolocation data)」を機微情報の位置づけ問題

「正確な地理位置情報」は、カリフォルニア州(Cal Civ. Code § 1798.121)やバージニア州(Va. Code § 59.1-517)を含め、最近のデータ・プライバシー法がそのような情報の収集と処理を規制しようとしていることにより、プライバシーの世界でホットボタンとなる問題となっている。「正確な地理位置情報データ」の定義は州によって異なるが、一般的には「デバイスから取得され、消費者の位置を特定するために使用される、または使用されることが意図されている、一定の距離(注6)を半径とする円内の地理的領域以下の地理的領域内のあらゆるデータ」を意味する。 現在、州レベルのプライバシー法の大多数は、正確な地理位置情報データを「機密個人情報」として分類している。この分類により、正確な地理位置情報データを収集および処理する組織に追加の義務が生じます。 例えば以下の州法を参照されたい。

① カリフォルニア州法: 正確な地理位置情報データを含む「機密個人情報」を収集および処理する対象となる組織・団体は、特定の例外を除き、その組織による「機密個人情報」の使用を制限する権利をカリフォルニア州民に提供する必要がある。

② バージニア州法: 対象となる組織・団体は、正確な地理位置情報データを含む「機密データ」を処理すること、およびデータ保護評価を実施および文書化することについて同意を得る必要がある。

(3) 日本のデータ保護影響評価 (DPIA)の重要性や義務化問題

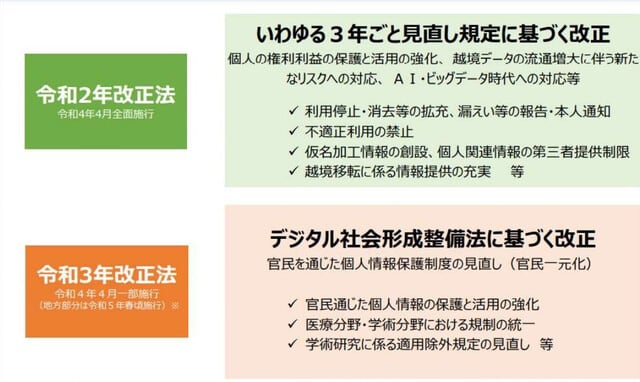

令和2年6月に成立した改正個人情報保護法(施行は、令和4年4月1日)には、データ保護影響評価(Data Protection Impact Assessment (DPIA)の実施を事業者に求めるという要件は含まれていない。しかし、令和元年12月の制度改正大綱において、民間の自主的取組の推進として、DPIAの実施が推奨されている。

このような動きに伴いDXを推進する組織は、個人識別可能情報1(以下、PIIという。)を処理するプロセス、情報システム、プログラム、ソフトウェアモジュール、デバイス又はその他の取組において、今まで以上にプライバシーに対するデューデリジェンス(善管注意義務)およびプライバシーバイデザイン(Privacy by Design)の達成が求められることとなった。DPIAは、潜在的なプライバシーへの影響を事前にアセスメント(評価)するための手段であり、ステークホルダーと協議してプライバシーリスクに対応するために必要な行動を起こすための手段である。DPIAを実施することは、プライバシーバイデザインを達成することである。

*****************************************************************

(注1) 米国の新しい州の「包括的な」プライバシー法には、子供に適用される規定がある。 たとえば、カリフォルニア州では、子供が 13 歳未満であることを実際に知っている企業は、COPPA の同意要件に加えて、その子供のデータを販売または共有する場合は親の同意を得る必要がある。 13 歳から 16 歳までの子どもの場合、カリフォルニア州法に基づき、企業は子どもの情報の販売または共有について子どもの同意を得る必要がある。 他の州では、子供の情報を「機密情報」と定義している。 そしてこれらの法律に基づき、企業は機密情報を第三者と共有する場合、消費者(未成年者の場合はその親)に通知しなければならない。 また、場合によっては、機密情報を処理する前にデータ保護評価を実施する必要がある。

さらに、企業は(やむを得ない理由がない限り)子供の地理位置情報を収集することはできず、サービスの提供に必要な個人情報のみの収集に限定される。 さらに、通知と条件は年齢に応じた言葉で提供される必要がある。 最後に、企業は子供が利用できるサービスを提供する前に、データ保護影響評価 (DPIA)を実施する必要がある。

第三に、連邦レベル (FERPA) と米国の州の約半分の両方で、学生のプライバシーに対処する法律がある。 これらの法律の主な焦点は、学校が生徒からどのような情報を収集できるかということである。 ただし、学校のビジネス・パートナーが生徒とどのようにやり取りできるかにも影響を与える。 たとえば、州法に基づき、学校のビジネス パートナーは、生徒の個人情報を不正なアクセス、使用、破壊、開示から保護する必要がある。 また、学校から要請があった場合には、生徒情報を削除しなければならない。

最後に、心に留めておく価値があるのは、ソーシャルメディア・プラットフォームを対象とした新しい米国の州法ですある。 これらの法律はこれまでにアーカンソー州、モンタナ州、オハイオ州、テキサス州、ユタ州で可決された。 しかし、発効予定だったすべての法律は延期されており、憲法修正第 1 条の言論の自由を理由に法律は違憲であるという難題に悩まされている。 一般に、これらの法律では、アカウントを作成する際に個人に年齢の提供を義務付け、アカウントが完成する前に子供の親の同意が必要となる。 また、プラットフォームが子供から収集できる情報の量や、子供がアクセスできる広告の種類も制限されることになる。( Sheppard Mullin Richter & Hampton LLPの弁護士Liisa Thomas氏 およびKathryn Smith氏のブログを抜粋、仮訳)

(注2) Immigrant (移民): 米国永住権保持者として米国内に居住している人。Status (在留資格/ステータス): 米国内に存在する、すべての人には、必ず何かしらのステータス (身分) があり、米国市民というステータス、永住権保持者というステータス、H-1B (特殊技能職) ビザ保持者のステータスという具合に、カテゴリごとに分けることができます。よって、米国で滞在するためには、外国人も、移民、非移民を問わず、必ず何かしらのステータスを保持していなければならない。

(注3) 「正確な地理位置情報」は、カリフォルニア州(Cal Civ. Code § 1798.121)やバージニア州(Va. Code § 59.1-517)を含め、最近のデータ・プライバシー法がそのような情報の収集と処理を規制しようとしていることにより、プライバシーの世界で大いなる議論(hot button)となる問題となっている。「正確な地理位置情報データ」の定義は州によって異なるが、一般的には「デバイスから取得され、消費者の位置を特定するために使用される、または使用されることが意図されている、一定の距離(注6)を半径とする円内の地理的領域以下の地理的領域内のあらゆるデータ」を意味する。 現在、州レベルのプライバシー法の大多数は、正確な地理位置情報データを「機密個人情報」として分類している。この分類により、正確な地理位置情報データを収集および処理する組織に追加の義務が生じる。 例えば以下の立法を参照されたい。

〇 カリフォルニア州法: 正確な地理位置情報データを含む「機密個人情報」を収集および処理する対象組織は、特定の例外を除き、その組織による「機密個人情報」の使用を制限する権利をカリフォルニア州民に提供する必要がある。

〇 バージニア州法: 対象となる組織は、正確な地理位置情報データを含む「機密データ」を処理すること、およびデータ保護評価を実施および文書化することについて同意を得る必要がある。

(注4) ダーク・パターン(Dark pattern)は、主にウェブサイトなどで、ユーザーを騙すために慎重に作られたユーザインタフェースのことである。認知バイアスを利用して、ユーザーが思っているよりも多くの時間やお金を使わせる。または注意を払うように設計されている。

例としては、購入時に保険に入会させたり、何かを定期購入させるなどの特定の行動をユーザーに促すものがある。また、「『購入ボタン』よりも『定期購入ボタン』の方が目立つ配色や大きさになっている」や「登録は簡単なのに退会が非常に面倒である」などの例もある。特に悪質なものが多いとされる例の1つは、利益が関わるショッピングサイトなどで、有名なウェブサイトほどダークパターンを利用しやすい傾向がある。ダークパターンには、プライバシー侵害や人々の判断力低下など複数の問題点が指摘されている。

ダークパターンの例:①おとり商法(bait and switch:値引きした商品をおとりとして、類似した高額な商品を買わせる商法。 baitは「餌」、switchは「(小枝で)むち打つこと」の意味)、②比較を困難にする(Comparison prevention)、③羞恥心に働き掛ける(Confirmshaming)、④偽装広告(Disguised ads)、⑤強制開示(Privacy zuckering)他(Wikipedia から抜粋)

(注5) プロファイリング:本人に関する行動・関心等の情報を分析する処理を行う場合には、分析結果をどのような目的で利用するかのみならず、前提として、かかる分析処理を行うことを含めて、利用目的を特定する必要がある。具体的には、以下のような事例においては、分析処理を行うことを含めて、利用目的を特定する必要がある。

(事例1)ウェブサイトの閲覧履歴や購買履歴等の情報を分析して、本人の趣味・嗜好に応じた広告を配信する場合

(事例2)行動履歴等の情報を分析して信用スコアを算出し、当該スコアを第三者へ提供する場合

(個人情報保護委員会サイト「個人情報取扱事業者は、個人情報の利用目的を「できる限り特定しなければならない」とされていますが、どの程度まで特定する必要がありますか」から抜粋)

(注6) カリフォルニア州の保護法(CPRA) では、地理位置情報データの精度と精度の範囲は半径 1,850 フィート(563.88m)以下である。 一方、他の州のプライバシー法では、半径は 1,750 フィート(533.40m)以下である。(JD SUPRAの用語解説「Precise Geolocation: Recent Trends and Enforcement」から抜粋、仮訳)

************************************************************

Copyright © 2006-2024 芦田勝(Masaru Ashida).All Rights Reserved.You may reproduce materials available at this site for your own personal use and for non-commercial distribution.