7月6日のEUROACTIVの記事を読んだ。表題のみではなにが問題であるのかが皆目わからなかった。その答えを見出すのに半日かかった。

結論を要約すると5つポイントがある。

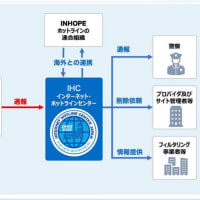

(1)欧州委員会が2020年は児童虐待を含む約400万件の画像と動画が報告され、同じ時期に、未成年者と仲良くするために性的捕食者によって使用される技術に関し1,500の報告がグルーミング(オンラインを介して相手の警戒心を解き信頼を得ようとすること(child grooming ; sexual grooming))のために提出された。これらに対応するためEUでは現行”ePrivacy Directive”があるものの、同委員会が策定した新しいEU暫定規則は、ハイテク企業が未成年者の性的虐待や子供を教育する試みを描写した資料を検出して報告することを目的として、自発的に対人コミュニケーションを監視できるシステムための法的枠組みを提供するものである。(注1)

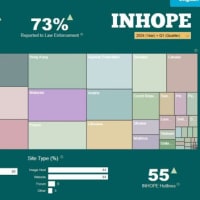

(2)米国に拠点を置くNGO「ソーン(Thorn)」は、過去15年間に報告されたグル―ミング・ファイルが15,000%増加したと指摘し、今回の新しいEU暫定規則を歓迎した。我々はオンライン児童の性的虐待の世界的な危機に直面しており、この戦いで後退する余裕はないと述べ、、Microsoft、Roblox、The Meet Groupなどのパートナーと協力して、特にマイクロソフトが、小児性愛者を検出するツールを開発、単語や話し方のパターンから自動検知するシステム”Project Artemis”等最近さらに一歩前進したと論じている。

他方、(3)欧州議会、欧州評議会、欧州データ保護監察機関(EDPS)、人権擁護団体であるEDRi等が強く反論している。

また、(4) 2021年2月10日、EU加盟国は、ePrivacy Regulation案に対するEU理事会の交渉義務に合意し、これにより、欧州連合理事会は、ePrivacy 指令(2002/58 / EC)に代わるePrivacy 規則の最終版について欧州議会との交渉を開始できるようになったが”ePrivacy Regulatin”とGDPRの関係である。この問題はEU内でも比較的詳しく論じられていない。2021.4.21 英国・ドイツ独立法律事務所activeMind.legal等が詳しく整理しているので併せて引用する。

最後に、(5)児童虐待規制立法の先進国(?)である米国や、ドイツ、英国等の状況を概観しておく。

これらを1回のブログで網羅できるか自信がないが、少なくとも筆者の手元に集めた資料をできる限り、整理、一覧化したい。

また、”ePrivacy Regulation”に関する検討経緯や概要については、2021年4月6日インターネットイニシアティブ 鎌田博貴「ePrivacy規則 閣僚理事会案について」や2020.11 5 第21回総務省:プラットフォームサービスに関する研究会(第21回)配布資料4「EU・eプライバシー規則(案)に関する議論の状況」P.13 (注2)が詳しくかつ体系的に解説している。この問題自体が別途論じるテーマであるため機会を改める。

なお、2回に分けて掲載する。

1.欧州委員会の問題意識と暫定規則案の主なポイントおよび議会の採択

(1)欧州委員会の暫定規則案策定の経緯と規則案

2021年月4月29日付けの欧州委員会のコミュニケがこれまでまのでの経緯を含め今後のEUの取組を明らかにしているので仮訳する。

○ 欧州委員会は、通信サービスにおけるオンラインでの児童の性的虐待の検出に関する暫定立法に関するる欧州議会と欧州連合理事会の間の本日の政治的合意を歓迎する。

この法的調整は、2020年12月21日時点でePrivacy 指令7/7(27)の下で児童の性的虐待をオンラインで検出して報告し、児童の性的虐待資料を削除するための自発的な措置において、ウェブメールやメッセージングサービスなどの特定のオンライン通信サービスに法的確実性を与えるために緊急立法が必要であった。

新しい規則は、プライバシーと個人データの保護を保護するための保証を提供する。すなわち、自主的な措置は、被害者の特定と救助を可能にし、児童の性的虐待資料のさらなる普及を減らすうえで重要な役割を果たし、犯罪者の特定と捜査、犯罪の防止に貢献する。

○本日合意された暫定規則は狭い範囲を持っている。すなわちそれらはオンライン通信サービスの自発的な検出活動に関する一時的かつ厳密に制限された部分的廃止(derogation)を作成する。本日の議会での合意の主な要素は次のとおりである。

○ この暫定規則は、その適用から遅くとも3年以内に適用されなくなる。 「児童の性的虐待とのより効果的な戦いのためのEU戦略」および「2021年の委員会作業プログラム」で発表したように、本委員会は2021年後半にオンラインとオフラインで児童の性的虐待と戦うための詳細な保護手段を備えた新しい包括的な法律を提案する。 これらの長期適用規則は、本日合意された暫定法に取って代わることを目的としている。

①児童の性的虐待に関する既存のEU規則(児童の性的虐待を構成するコンテンツや児童の勧誘など)に沿ったオンラインでの児童の性的虐待の定義を行う。

②誤って削除されたコンテンツをできるだけ早く復元できるようにする苦情対応のメカニズムを策定する。

③必要に応じて、公的利益のために行動する法執行当局または組織に報告する前に、個人データの処理に対する人間による監視ができることとする。

④プライバシーを保護するための保証:

サービス・プロバイダーは、オンラインで児童の性的虐待を検出するために使用する技術がプライバシーに最小限に侵入しないようにする必要がある。

⑤データ保護対策:

サービス・プロバイダーは、オンラインで児童の性的虐待を検出して報告し、児童の性的虐待資料を削除するために、処理に関するデータ保護当局と協議する必要がある旨を明確化した。また、欧州データ保護会議(EDPB)は合意された規制の範囲内で処理の一般データ保護規則(GDPR)の遵守を評価する際に関係当局を支援するためのガイドラインを公開するよう求める。

⑥ 欧州委員会は、児童の性的虐待に対して公共の利益のために行動する組織の公的なレジスタを確立する必要があり、オンライン通信サービス・プロバイダーは、自発的な措置に起因する個人データを共有することができる。

⑦ 年次透明性レポートによりサポートされるべき透明性と説明責任を担保する。

⑧ 暫定規制の適用を3年間とする制限は、この分野での長期法制の採用のための検討時間を可能にする。

○ 次のステップ

現在、暫定規則は欧州議会と欧州連合理事会により正式に採択されなければならない。この暫定規則は、その適用から遅くとも3年以内に適用されなくなる。

【暫定規則案の提案の背景】

児童の性的虐待に対するより効果的な闘いのためのEU戦略で発表したように、委員会は2020年9月に、ウェブメールやメッセージング・サービスなどの特定のオンライン通信サービスの提供者が、これらのサービス・プロバイダーが、欧州電子通信コードの近代化された定義により、電子プライバシー指令(ePrivacy Directive)の範囲内に入った場合、児童の性的虐待をオンラインで検出して報告し、2020年12月21日を超えて児童の性的虐待資料を削除するための自主的な措置を継続できるようにするための暫定法案を提案した。

現行のe-Privacy指令には、児童の性的虐待をオンラインで検出して報告し、児童の性的虐待を取り除く目的で、コンテンツや交通データを自主的に処理するための明示的な法的根拠は含まれていない。今回提案された暫定規則案は、これらのプロバイダーがオンラインで児童の性的虐待を検出して報告し、サービス上の児童の性的虐待資料を削除するための活動を維持することを可能にする一時的かつ厳密に制限された規則の部分的廃止の根拠となる。

(2) 欧州委員会の暫定規則案の議会の可決に関するRACTIVの記事を仮訳

欧州議会は、7月6日、電子通信サービスの提供者が児童の性的虐待を描写した資料を含むプライベート・オンライン・メッセージをスキャンして報告することを可能にする一時的な措置であるが、逆にePrivacy指令の保護低下に繋がる欧州委員会の規則案、EU規則最終版(final Reulation) COM(2020) 568 finalを採択した。また、この規則は、IT企業が違法なグルーミング技術を検出するために承認された技術を適用することをも可能にする。

「この暫定規則は、企業の不確実性を終わらせるが、それは子供たちに危険を終わらせるものではない。これは、急性の緊急事態を修正するための一時的な解決策に過ぎない。本来は「子どもたちに対する永続的な脅威に対抗するための恒久的な答えが必要である」と、イルバ・ヨハンソン( Ylva Johansson)欧州委員会の域内担当委員は7月5日に欧州議会で法案を提示した。

Ylva Johansson 氏

欧州委員会によると、2020年は児童虐待を含む約400万件の画像と動画が報告された。同じ期間に、未成年者とえせ友だちとなるために性的捕食者によって使用される技術に関し1,500の報告がグルーミングに関し提出された。ユーロポール(Europol)によると 、COVID-19パンデミックの間にこの状況はさらに悪化している。

(3)プライバシー vs. 児童の保護

新しいEU規則は、ハイテク企業が未成年者の性的虐待や子供を教育する試みを描写した資料を検出して報告することを目的として、自発的に対人コミュニケーションを監視するシステムための法的枠組みを提供するものである。

米国に拠点を置くNGOである「ソーン(Thorn)」は、過去15年間に報告されたファイルが15,000%増加したと指摘し、今回の新しいEU規則を歓迎した。「我々はオンライン児童の性的虐待の世界的な危機に直面しており、この戦いで後退する余裕はない」とソーンの対外関係担当副会長VPのサラ・ガードナーは述べた。

Sarah Gardner氏

しかし、他方このEU規則はあまりにも押し付けがましく、民間通信の無差別監視を可能にしていると批判されている。EUの公的プライバシー・ウォッチドッグである欧州データ情報保護監察機関(EDPS))は、2020年11月10日の拘束力のない意見の中で、今回の措置とプライバシーの基本的権利との互換性に疑問を呈した。同様の懸念は、欧州評議会の報告でも表明された。

プライベートな会話のスキャンは、人工知能を搭載した自動コンテンツ認識ツールを通じて行われるが、人間の監督下で行われる。サービス・プロバイダーは、データ保護当局との協議の後、相手の警戒心を解き信頼を得ようとしないアンチ・グルーミング技術を使用することもできる。

欧州デジタル人権と自由権擁護ネットワーク(EDRi)の政策責任者であるディエゴ・ナランホ(Diego Naranjo)はEURACTIVに対し、この欧州委員会の提案は「あまりに急いだ」と述べ、「議論は合理的から感情的な議論に移された」ため、プライバシーの権利とオンラインで子供たちを保護する必要性とのバランスを取ることができなかったと語っている。

(4)物議を醸す結果

最終的な規則文案を交渉するに当たって、欧州議会はいくつかのプライバシー上の懸念を提起した。つまり、交渉をリードするMEPであるBirgit Sippelの主な改善点には、通信のスキャンの可能性についてユーザーに明確に知らせることが含まれ、明確なデータ保持期間と技術の展開に関する制限も含まれていた。

Birgit Sippel 氏

しかし、MEPパトリック・ブライアー(Patrick Breyer )は、自動化されたツールが86%のケースで関連性のないコンテンツを報告し、ユーザーに通知されることなく民間組織や警察当局に不審な通信を開示することになると述べ、最終的な妥協案を批判した。

Patrick Breyer 氏

プライバシーに関する懸念は、ヌード写真やセックスなどの成人間の正当な私的コミュニケーションを暴露するリスクに関連し、虐待の扉を開く可能性がある。

5Rights FoundationのEU担当責任者であるレアンダ・バリントン・リーチ(Leanda Barrington-Leach)にとって、新しい規則は「EU憲章の要求に応じて、プライバシー権の潜在的な乱用と子供の最善の利益の優先順位を考慮して、児童の性的虐待の非常に現実的で進行中で凶悪な犯罪に比例した対応」を提供すると評価した。

一方、児童虐待の元被害者であるアレクサンダー・ハンフ(Alexander Hanff)は反対する。彼は新規則の条項を公然と批判し、機密カウンセリングのために被害者のチャンネルを奪うと主張した。「子どもたちが虐待されるのを防ぐものではなく、虐待をさらに地下に追いやり、発見をますます困難にする。それは最終的により多くの子供たちが虐待されることにつながる」と、ハンフが強く述べた。

(5)EUの児童の性的虐待問題に対処すべく長期的な立法計画

2021年の初め、EU法に基づく「電子通信の定義」は、メッセージング・サービスも含むように変更された。(注3)その結果、プライベート・メッセージは、EUのプライバシー・フレームワークであるGDPRの範囲内ではなく、「2002年ePrivacy指令」を適用することとなった。

GDPRには児童の性的虐待を検出するための措置・規定が含まれているが(注4)、ePrivacy指令には当てはまらない。法的体制の変更により、多くのオンライン・プロバイダーは自発的な報告を停止させ、2021年初からこれまで53%減少した。

(6)ePrivacy暫定規則の関係でみる「デジタル・サービス法案」(注5)

2017年、欧州委員会はePrivacy指令を改訂する提案を出したが、交渉は何年も停滞しており、代わりに一時的な措置を講じなければならなかった。今回の一時的な解決策は2025年12月31日まで実施されるが、改訂されたePrivacy指令が発効する時点ではいつでも廃止されうる。

一方、2020年12月15日、欧州委員会は、「デジタルサービス法(Digital Services Act:DSA)」) (欧州委員会の解説サイトと「デジタル市場法(Digital Markets Act:DMA)」 (欧州委員会の解説サイト)と題する新たなデジタル・プラットフォーム規制法案を欧州議会と欧州連合理事会に提出した。

両法案の内容をそれぞれ一言でまとめるならば、DSAはデジタル・プラットフォームに対して違法コンテンツへの対策を求めるものであり、DMAはデジタルプラットフォームによる自社サービスの優遇を禁止するものと言える。(2021.6.28 情報通信総合研究所 主任研究員 鈴木 康平「EUのデジタルサービス法案の概要・検討状況と日本のデジタルプラットフォーム規制との関係」から一部抜粋。なお、このレポートは丁寧に解説されているが、注記のURLリンクに関してほとんどがエラーとなる。筆者のブログのように掲載時に直接リンクを張ることで読者のデータの原データの確認作業が大幅に軽減できるし、正確性が高まるといえる)

DSAの対象となるのはプロバイダ-であり、サービスの種類ごとに、①仲介サービス(intermediary service)、②ホスティング(hosting)、③オンライン・プラットフォーム、④超巨大プラットフォーム(Very large online platforms)の4つに分類される。特に筆者は以下のプロバイダの免責に関する規定に注目した。

すなわちホスティングサービスのプロバイダ-は、①違法行為等を知らないこと、又は、②違法と知った場合には、違法なコンテンツを速やかに削除又はアクセス不可の措置をとること、を満たす場合、保管された情報について責任を負わない(5条)。この規定は電子商取引指令14条に相当するが、電子商取引指令にはなかった内容として、オンライン・プラットフォームの消費者法上の責任について、平均的かつ合理的な消費者が、提供されている商品等について、オンライン・プラットフォーム自身やその支配下等にあるサービス受領者によって提供されていると信じるような方法で提供されている場合には免責されない旨の内容がDSAには追加されている(5条3項)。関連して、DSA前文18段では、仲介サービスプロバイダが中立的にサービスを提供するにとどまらない場合(提供された情報を単に技術的・自動的に処理するだけでなく、その情報に関する知識を得たり、管理したりするような積極的な役割を果たす場合)には、DSAの免責は適用されないとされている。

また、プロバイダーには、送信又は保存する情報を監視する義務や、違反行為を積極的に探す義務は課されない(7条)。この規定は電子商取引指令15条に相当するが、電子商取引指令では、プロバイダーに対して、そのサービス利用者が行った違法行為や提供した違法な情報を管轄当局に通知する義務を課すことを加盟国が定めることができるとしているものの、義務を課すための具体的な要件は定められておらず、加盟国の判断に委ねられていた(電子商取引指令15条2項)。DSAではそのような義務は課されていないが、代わりに犯罪行為が疑われる場合の法執行機関への報告がオンライン・プラットフォームに対して義務化されている(21条)(前記 鈴木 康平 「EUのデジタルサービス法案の概要・検討状況と日本のデジタルプラットフォーム規制との関係」から一部抜粋)。

欧州委員会は、2021年末までに児童の性的虐待とオンラインおよびオフラインで戦うための包括的な法案の提案を見込んでいる。

2.Microsoft、Thornおよび他のパートナーの新しいグルーミング防止ツール

(1) 2020.2.11 Thorn「Microsoft、Thorn、およびパートナーの新しいグルーミング防止ツールに会おう]を仮訳する

○この新しいグルーミング防止技術について知っておくべきこと

テクノロジーは強力なツールである。子供たちをオンライン上で安全に保つために使用することを決定できる。

ソーンでは、子供たちがテクノロジーと対話し、安全で好奇心が強く、幸せでいられる世界を構築することを固く信じている。その世界を構築するにはさまざまなソリューションが必要であり、Microsoft、Roblox、The Meet Groupなどのパートナーと協力して、最近さらに一歩前進した。

”Project Artemis”という言葉を聞いたことがあるかもしれない。 これはツールに関連することが多い用語であるが、実際には元々、内部目的のコードネームとしてのみ使用することを目的としていた。 混乱を避けるために、この新しいグルーミング防止ツールをProjectArtemisの前進とは呼ばない。

しかし、この問題はそれほど重要ではない。これは、子供たちのオンライングルーミングを検出し、IT企業や通信事業者がいつどこでそれを中断して報告するのに役立つ、初めての手法である。

A.このアンチ・グルーミング・ツールはどのように始められたのか?

オンラインによる略奪的グルーミングは、子供を性的搾取に強制するために子供の信頼を得るために設計された戦術または一連の戦術といえる。身だしなみは、性的虐待、性的虐待、人身売買につながる可能性がある。

最近のニューヨークタイムズの記事は、マルチプレイヤービデオゲームのチャット機能を介してグルーミングが急増していることを指摘している。ソーンは、ユーザー生成コンテンツをホストする、またはピアツーピアの相互作用を可能にするすべてのプラットフォームが、グルーミングや悪用が発生する可能性がある場所であることを知っている。

ニューヨークタイムズの記事の1年以上前に動いていたアンチグルーミング・テクニックを実際入力してみてください。このツールは、2018年後半にオンライングルーミングに対処するためにMicrosoftが主催したハッカソン(注6)中にシードされたものである。

”WePROTECT Global Alliance”と”Child Dignity Alliance”が後援するこのハッカソンには、Roblox、Kik、Thorn、The Meet Group、Microsoftなどの技術リーダーのチームが集まった。このプロジェクトは、児童の性的搾取の画像をオンラインで検出して報告するためのPhotoDNAツールを開発したカリフォルニア大学バークレイズ校情報学部の教授で副学部長であるHanyFarid氏が主導した。教授の専門はデジタルフォレンジック、フォレンジックサイエンス、偽情報、画像分析、および人間の知覚 などである。

HanyFarid 氏

B.アンチグルーミング・ツールは何ができるのか?

これは、テキストベースのチャットをスキャンしてグルーミングの可能性を探り、個々の企業がグルーミングの可能性を監視して法執行機関に報告できるようにする手法である。

それは、子供の性的虐待グループを混乱させ、IT企業や通信事業者等がそれが実施されたプラットフォームでのグルーミングを報告できるようにするのに役立つ。

C.グルーミング防止ツールは誰が使用できるか?

プラットフォームでのオンラインの略奪から子供を保護しようとしているチャット機能を備えたテクノロジー企業は、この技術の無料使用を申請できる。法執行機関および非政府組織(NGO)も申請する資格がある。

このツールのライセンス取得と配布はThornによって管理されている。 2020年1月の時点で、ソーンはMicrosoftからツールの管理を移行し始めた。これは、2020年の春までに完了する予定である。アクセスに関心のある方は、antigrooming [at] thorn.orgに問い合わせてください。

D.グルーミング防止ツールの次は何ですか?

ThornのCEOであるJulie Corduaが語ったように、「プラットフォームが失敗した自己管理の慣行から離れ、子供の手入れや虐待の予防的な防止に向けて動く時が来た」

この手法は完全な解決策ではないが、この戦いで積極的になるための大きな前進である。デジタル・ツールボックス(注7)に追加されたすべてのテクノロジーは、ソーンのテクノロジー・ベースのアプローチの影響を増大させる。ツールを追加すると、ツールもシャープになり、強化される。

今後もパートナーと協力して、新機能の開発、言語の追加、新しい機能の構築を行っていく。私たちは、現場でこの手法を利用している企業や組織と協力して、反復し、継続的に改善する。

インターネットから児童の性的虐待を排除することができる。チームとして最先端のテクノロジーを構築および実装することは、子供が安全で好奇心旺盛で幸せな世界を作るための重要な構成要素である。

これは重要なマイルストーンであるが、ほんの始まりにすぎない。

(2)分かりやすい解説例

2020.1.22 Gizmode「マイクロソフトが、小児性愛者を見つけるツールを開発。単語や話し方のパターンから自動検知」(Technology Reviewの日本語訳)

一部抜粋する。

「そんな親の心配は万国共通。だから、マイクロソフトはオンラインで子供をターゲットとした性犯罪者を自動検知するシステム「Project Artemis」を作ったとTechnology Reviewが伝えた。

Technology Reviewが伝えた詳細によると、「Project Artemis」は、単語や話し方のパターンに基づいて、チャットの参加者が繕っているかの可能性を評価するのだそうだ。スコアを設定して、一定のスコアを超えるとフラグ付けされた会話がモデレーターに送られてレビューされるそうでである。モデレーターが危険と判断すれば、法執行機関に報告することもあるとのことである。

また、児童保護の専門家の協力で、ペドフィリア(pedophilia:小児性愛者)がオンラインでどのような活動をしているのかも把握できるそうである。

どのような単語や話し方がペドフィリア認定の材料になるのかは明かされていないので詳細はわからないが、例えば、大人が年齢を偽って子供の振りをしようとした時なんかに違和感が出たりするのかもしれない。

マイクロソフトはこの技術を「Xbox」や「Skype」で数年間使ってきたそうである。そして今後は、子供たちをペドフィリアから守るために技術開発している非営利団体の「Thorn」を通して、オンラインチャットを運営している企業に無料提供する予定になっているそうだ。

3.欧州評議会、欧州データ保護監察機関(EDPS)、人権擁護団体であるEDRi等のプライバシー保護面からの具体的問題提起

(1) 2020.12.11 欧州評議会の欧州委員会の草案に対する修正意見報告

【立法の正当化理由】

オンラインでの児童の性的虐待の問題は非常に深刻であり、被害者の生活のあらゆる面でそのようなひどい結果を伴うため、決して軽視することはできない。同様に、インターネットの使用が爆発的に増加し、そのツールやアプリケーションが増え続けることで、ポルノ・コンテンツを検索する消費者の天国になった。データによると、最年少のインターネットは12歳から17歳までの範囲であり、ポルノ素材への依存は、ポルノが人体、女性と男性の間の関係と相互作用のひどく歪んだ見方を提示するので、人間の心に重大な影響を及ぼす。これに、ミラの非常にカバーされたケースのように、脆弱な女性と少女を対象とした性的ネットいじめの増大する問題を追加する必要がある。後者は、フランスのLGBT女子高生で、2020年の初めに保護下に置かれ、イスラム教を批判した後、インターネットでのオンラインレイプと殺害の脅迫を受けて学校から退学させられた。

最後に、何年にもわたって提起されてきた性的虐待の虚偽の申し立ての事件は、加盟国の関連当局がこれらの故意に作成された事件の作者が完全に法的責任を負うようにあらゆる措置を講じることを正当化する。一般に、子供に対する性犯罪の疑いの段階から、犯罪者に対する起訴と制裁に至るまで、正義が勝つためにはすべての予防措置とベストプラクティスを適用する必要がある。

見たところ、子供に対する刑事性的行為の虚偽の告発のために開始された手続上の誤りまたは刑事事件は、時には罪のない市民を制裁することによって正義の道を混乱させる可能性がある。したがって、女性または男性がオンラインの児童性的虐待の疑いの対象となった場合、無罪の推定の原則が決して無視されないことが重要である。

オンラインでの児童性的虐待の根底にある問題に取り組むには、他の戦略の中でもとりわけ、学校と保護者が協力して、自分自身、自分の体、自分のイメージ、尊敬の観点から関係を築くように子供たちを教育する必要がある。

自分自身と他人を尊重することは、身体を客体化することなく、感情的および精神的な次元で人間を評価することから生じる。

最後に、有罪判決を受けた児童虐待者に関する十分なデータが入手できないことを残念に思い、有能な関係者がこの点で彼らの努力を強化することを要求する。ただし、これは、委員会の提案に記載されているように、必要かつ法的に許可されている場合に限り、電子プライバシーの権利に関する措置を講じることの重要性と矛盾しない。

(2)Data Guidanceから抜粋、仮訳

欧州データ保護監察機関(「EDPS」)は、2020年11月11日に、「プライバシーおよび電子通信に関する指令(2002/58 / EC)(ePrivacy Directive)」からの一時的な低下させる欧州委員会の提案に関する意見7/2020(Opinion 7/2020)」(注8)を発表した(オンラインでの児童の性的虐待と闘うことを目的とした「ePrivacy Directiveの改正案)。特に、EDPSは、エンドユーザーとその権利がこれらを使用する際に効果的かつ平等に保護されることを保証する目的で、同等のオンラインサービスを含むように「電子通信サービス」の概念を拡張することが欧州議員の目的であることを強調した。 ePrivacy Directiveからの委任に関連する問題は、法執行目的のコラボレーションを目的としたすべてのイニシアチブに適用される。

より具体的には、以下の目的で個人データおよびその他のデータを処理するための、番号に依存しない対人通信サービスプロバイダーによる技術の使用に関する”ePrivacy Directive”の特定の規定からの逸脱を管理する将来の規制に関する欧州委員会の提案に基づいてオンラインでの児童の性的虐待との闘いにおいて、EDPSは、通信の機密性が最も重要であり、欧州委員会の提案で概説されている措置は、インスタント・メッセージング・プラットフォームおよびアプリケーション含む広く使用されている電子通信サービスのユーザーの私生活とデータ保護を尊重する基本的な権利と矛盾することに留意した。

さらに、EDPSは、とりわけ同委員会の提案が一般データ保護規則(EU規則(EU)2016/679):GDPR)の意味の範囲内で処理するための法的根拠を提供するかどうかを明確にする必要があると概説した。

また、個人データが影響を受ける人がデータが悪用のリスクから効果的に保護されることを十分に保証できるように、新規則には問題の措置の適用と最小限の保護措置の適用に関する正確な規定を含める必要がある旨論じた。

(3)人権擁護団体であるEDRi政策代表Diego Naranjo氏の暫定規則の反対意見の仮訳

Diego Naranjo氏

本質的に、欧州議会で採択された暫定規制(2022年12月に有効でなくなる一時的な規制である)は、特定のサービスプロバイダーが常にすべての通信の自主的なスキャンを継続し、オンライン児童性的虐待資料(CSAM)を検出して当局に報告することを可能にする。最後の規則案のテキストは、 ここ にある。

A.なぜ私は懸念する必要があるのか?

全体として、この法律は、民間企業によるすべての通信の継続的な自主的なスキャンを合法化するという意味で否定的な意味で進化である。暫定規制の範囲内のサービスは、Facebookメッセンジャーのメッセージ、出会い系Tinderチャット、電子メール、および将来的に発生するその他のオンラインコミュニケーションを含むePrivacy指令と同様に広く定義されている。

B.こんまま続けていいか? ビッグテックはすでに私のプライベート・コミュニカティションを引き起こしているのか?

これは驚くべきことであるが、最初の提案では、未定義の数のプラットフォーム/サービスがすでに暗号化されていないプライベート通信をスキャンしていたことが明らかになった。欧州委員会がそのような実務慣行の法的根拠は何かと尋ねられたとき、彼ら自身が手がかりを持っていなかったことを認めた。つまり、エンドツーエンドの暗号化通信を使用していない場合は、サービスを実行している会社が通信をスキャンする可能性があると仮定する必要がある。

C.メッセージの自主スキャンの可能性? 誰がそんなことをするのか?

いい質問である!自主スキャンしているサービスやアプリケーションの公式リストはないが、Facebookは少なくともすでにこれを行っているように見えるし、他の人がフォローする可能性がある。すなわち、あなたのティンダースパイシー(わいせつな)会話もスキャンされるかもしれない。

D.なぜ今、規則を制定するのか?

第一に法的な理由がある。欧州電子通信コード(EECC) (注9)が施行されたため、ほとんどのオンライン通信サービスや事業者はプライバシーと機密性を尊重する義務がある。我々はすでに別のところで説明したように、これは良いニュースだったはずですが、弱いプライバシーと通信の機密性の支持者は、これらの新しいルールを施行することは、EUが「小児性愛者のための安全な避難所(“safe haven for peadophiles”)」になることにつながると主張した。

第二の理由は、Facebookがエンドツーエンドの暗号化でFacebookメッセンジャーの会話を暗号化することに決めたということである(それは他の製品WhatsAppの場合と同様である)。これらの会話を暗号化すると、Facebook(および他の誰も)があなたの会話の内容を読むことを妨げ、これらのプラットフォームで検出されるCSAM(Child Sexual Abuse Material :オンラインの性的な児童虐待画像)の数が減少すると言われている。その結果、彼らはこれが裁判所に連れて行かれる容疑者の数を減らすことになるだろうと主張している(そして、より違法な資料が広く集められている)。

E.この狂気の施策はいつまで続くのか? 私は何かを行うことができるか?

暫定規制は2022年12月まで施行され、その間に長期的な立法による解決が開発され、採択される予定である。CSAMに関する長期適用法は、2021年10月に欧州委員会によって提案される予定でである。暫定規制に関しては、我々ができることは何もありません。しかし、私たちの地元のデジタル著作権団体に連絡し、採用されたばかりの法律に代わる今後の長期的な法律の前にどのように役立つかを尋ねることを勧奨する。

F.暫定規則はプライバシー保護からどのように見えるか?

一言で言えば、この暫定規制の最悪の側面は、例えばテロや「国家安全保障」の実現を防ぐために、企業や政府があなたの私的なコミュニケーションやオンラインインタラクションを読むことを可能にする危険な前例を作り出すということである。

また、暗号化が犯罪者を保護するという一般的で繰り返しの物語を提供する(欧州委員会からのこのツイートでは、暗号化に関するポイントはバラクラバを身に着けている人によって示されている)。欧州議会の議長によると、議論は急いで、巨大な圧力を受けた。彼らは、欧州連合司法裁判所((CJEU))の前に異議を申し立てられた場合、今回の暫定規則は深刻な分析に抵抗しないだろうと言ってさらに進めた。

**************************************************************************************:

(注1) なぜ欧州委員会が3年間という期間限定の暫定規則をとりまとめたのかが疑問である。つまり、委員会の真の狙いは長期的観点にたった””ePrivacy regulationの早期決定することではないか。現に2019年9月の規則案での追加条文第6d条(注2)で見てのとおり、これらデータ処理企業に児童ポルノを構成する要素の検出、削除および報告することのみを目的とした行為は許可されると書いてある。

欧州委員会の真の狙いはマイクロソフトが提供する、小児性愛者を検出するツールを開発、単語や話し方のパターンから自動検知するシステム”Project Artemis”に法的根拠を与えることだけなのか。

(注2) 2019年9月時点のePrivacy regulation (draft)の新規提案を読んだ。原文はここp.60である。

訳文は2020.11 5 第21回総務省:プラットフォームサービスに関する研究会(第21回)配布資料4「EU・eプライバシー規則(案)に関する議論の状況」P.13である。ただし、この条文が今回欧州委員会がまとめた暫定規則に該当するか否かはなお、調べてみたい。

(注3)「電子通信」の定義の変更

EUは従来、「電子通信(Electronic Communications)サービス」は「電気通信(Telecommunications)サービス」と「放送用の伝送(Transmission)サービス」から構成されるとしてきたが、欧州電子通信コード(EECC)指令(2020/12/21)7/7(51)においては前者(「電気通信」)をさらに「個人間通信サービス(Interpersonal Communications Service)」と「インターネット接続サービス(Internet Access Service)」の2つに区分した。その結果、回線(すなわちインターネット接続)を保有しないプラットフォーマーであっても、「個人間通信」の提供事業者に該当することとなり、電子通信サービスの規制対象として補足することが可能となった。

(注4) GDPR第8 条 情報社会サービスとの関係において子どもの同意に適用される要件

第18 条 取扱いの制限の権利

- データ主体は、以下のいずれかが適用される場合、管理者から、取扱いの制限を得る権利を有する:

(a) 個人データの正確性についてデータ主体から疑義が提示されている場合、その個人データの正確性を

管理者が確認できるようにする期間内において。

(b) 取扱いが違法であり、かつ、データ主体が個人データの消去に反対し、その代わりに、そのデータの

利用の制限を求めている場合。

(c) 管理者がその取扱いの目的のためにはその個人データを必要としないが、データ主体から、訴訟の提

起及び攻撃防御のためにそのデータが求められている場合。

(d) データ主体が、管理者の正当性の根拠がデータ主体の正当性の根拠よりも優先するか否かの確認を争

い、第21 条第1 項により、取扱いに対する異議を申立てている場合。

第21 条 異議を述べる権利

- 情報社会サービスの利用の過程において、かつ、指令 2002/58/EC にかかわらず、データ主体は、技術的な仕様を用いる自動化された仕組みによって異議を述べる自己の権利を行使できる。

第40 条 行動規範

(g) 子どもに対して提供される情報及び子どもの保護、並びに、子どもに対して親権者としての責任を負う者から同意を得るための方法;

(注5) 今回の暫定規則とデジタル・サービス法案の関係はわかりつらい。

(注6)ハッカソン( hackathon )とは、ソフトウェア開発分野のプログラマやグラフィックデザイナー、ユーザインタフェース設計者、プロジェクトマネージャらが集中的に作業をするソフトウェア関連プロジェクトのイベントである。(Wikipediaから一部抜粋)

(注7)Thornが言うdigital toolboxとは、”Project Artemis”を指す。詳しくはMicrosoftのblog解説を参照されたい。

(注8)2020.11.10 EDPS 「Opinion 7/2020 on the Proposal for temporary derogations from Directive 2002/58/EC for the purpose of combatting child sexual abuse online」(全19頁)参照。

(注9) 欧州電子通信コード(EECC)指令(2020/12/21)の電子通信サービス (ECS) の新定義が以下のとおり変わった。

通常は対価を伴い、電子通信網上で提供されるサービスで、以下を包摂(encompass):

- インターネット接続サービス

- 個人間通信サービス(番号サービス、非番号サービス)

- 主として信号伝送を提供するサービス(例:M2M向け、放送向け)

除外:伝送されるコンテンツを提供・編集するサービス

すなわち、EECCでECS定義に追加されたのは、信号伝送を主たる機能とせず、インターネットなどの通信網上で提供される個人間通信サービス。例えば、Webメール、メッセンジャーサービスなど。個人間通信サービスには、サービスに付随する補助的なもの(ゲームにおけるチャット)、機械間の情報交換は含まれない(EECC2(5), 前文17項)(2021年4月6日株式会社インターネットイニシアティブ 鎌田博貴「ePrivacy規則 閣僚理事会案について」から一部抜粋。

*******************************************************************************************************:

Copyright © 2006-2021 芦田勝(Masaru Ashida).All Rights Reserved.You may reproduce materials available at this site for your own personal use and for non-commercial distribution.

※コメント投稿者のブログIDはブログ作成者のみに通知されます