未来のAIに“意識”は宿るか AI・認知科学の専門家に聞く

AI」(Artificial Intelligence:人工知能)という言葉はいくつかの意味で用いられている。近年は、画像認識プログラムなど特定の問題を人のようにうまく処理するプログラムが「AI」としてよく取り上げられる他、もっと単純なルールベースで人の作業を肩代わりするプログラムが「AI」とバズワード的に呼ばれることもある。

ソニーの犬型ロボット「aibo」 本物の犬との共生実験では犬がaiboを「生き物」と認識するケースが多かった

こうした「特定の問題を解くAI」が取り沙汰されるのはそれだけ成果を上げているからで、ここ数年で研究者のみならず世界中にインパクトを与えた出来事の一つには、例えば米DeepMindの囲碁AI「AlphaGo」の登場が挙げられるだろう。

しかし、「AI」という言葉が指し示すものに、もっと違う印象を抱いている人もいるのではないだろうか。例えば日本の作品でいえば「ドラえもん」や「鉄腕アトム」、海外のSF作品なら「2001年宇宙の旅」のコンピュータ「HAL 9000」や「アンドロイドは電気羊の夢を見るか」に登場するアンドロイドなどに代表されるような、「機械に宿る、人間と同等かそれ以上の汎用的な知能」のことを「AI」という言葉からまず思い浮かべる人もいると思う。

ソフトバンクの「Pepper」のように“感情表現”をプログラムしたロボットも現れつつあるが、先に挙げた架空の作品のような「AI」を実現した例はまだない。

今の「AI」は、これからどのような進化をしていくのだろうか。技術革新の中で、AIやそれを搭載したロボットに人と同じような意識や自由意志が宿ることはあるのだろうか。

神経生物学やAIについての研究室を多く擁する沖縄科学技術大学院大学(OIST)で、2人の専門家を取材した。 次のブレークスルーは「自律性を持つAI」

まず話を伺ったのは、精神や認識を研究する「認知科学」について、体と外界の相互作用の面から研究しているトム・フロース准教授。

フロース准教授は、AIの今後について「次のブレークスルーとなるのは、自律性を持ったAIの登場だろう」という。

フロース准教授 最近のAIは定義されたドメインの中ではうまく問題を解決できるが、実際の世界はオープンエンド(問題の範囲が定められていない)。AIをより汎用的に用いるなら、人が定義した範囲でしか動かないものではなく、AI自身が自律してクリエイティブに動ける必要がある。

このような自律性を持つAIには、外界と常に相互作用を持つことが必要になる。今のAIは、コンピュータが定義した範囲で受け取った入力に対しては出力できるが、生命のように外界のあらゆる刺激にリアルタイムに反応したり学習したりといったことはできない。つまり、自律AIには生命のような特徴が必要だ。

生命が知能を持つルールは今も理解できていないが、身体性は関係しているだろう。生命は常に外界と相互作用する体を持ち、命が尽きるまで活動が止まることはない。その一方で、機械(AI)は電源を切れる。ロボットが動かなくなったら人間が直せばいいが、ロボットが自分自身の活動を止めないように気に掛けることはない。

□ □ □

フロース准教授はこのように、問題(外界)に自律的に対応できるAIには生命の体に見られるような特徴が必要だという見解を示した。

自由意志はロボットに宿るか

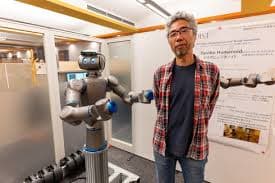

フロース准教授とは別の研究室ながら、ロボットへのプログラミングから脳の認知メカニズムを解明しようとしているのが、谷淳一教授だ。

谷教授は、「意識の正体は私の中でははっきりしている」としつつ、「ロボットが人ほどの自由意志を持つのは難しいのではないか」と話す。

□ □ □

谷教授 意識の正体はすでに私の中でははっきりしている。例えば、ここに赤い(PC用)マウスがあるとする。それを見たときになぜ「赤いマウス」と認識するかというと、脳の中にその情報を折りたたんだ“モデル”があるから、それを展開して「赤いマウスである」と認識する。これが脳から末端への“トップダウン”の流れ。

その一方で、物体を認識するには目で見たり、手に取ったりといった感覚器官からの情報が必要。これは末端から脳への“ボトムアップ”の流れ。トップダウンの抽象化されたモデルと、現実世界の光量などボトムアップの状況は全ては一致せず、コンフリクト(衝突)する。このぶつかりを何とか最小化しようと、「こうかな、こうかな」と神経活動が活発になる。これが意識だと考えている。

この意味では、例えば自閉症は“過学習”の傾向があるのではないかと考えている。他人の挙動をうまく説明できるように毎回すごく学習して過学習状態になってしまうが、他人はそもそも予測から外れた動きをするもの。普通程度の学習なら予測から外れても「誤差」として許容できるところ、過学習状態では毎回予測から大きく外れ、コンフリクトが大きくなる。これをまた修正しようと過学習し、次の予測がまた外れるので、対人関係が難しくなってしまうのではないか。

谷教授はこうした仮説を基に脳機能をロボットへプログラムすることで、ロボットが持つ“トップダウン”の予測と、機械の体から受ける“ボトムアップ”の感覚を再現し、ロボット上に4歳児程度の知能や心を生み出すことを目標としている。

しかし、それでもロボットに大人の人間ほどの自由意志が宿るかについては懐疑的だ。

谷教授 人間の赤ちゃんは、両親から毎日長時間の面倒を見てもらって育つ。つまり、それだけ長い時間、両親(つまり他人)から愛情を受け学習しているのが自他の区別や自由意志の発達に関わっている。しかも、人間の場合はディープラーニングのように一つの物体を100万回も見なくても学習できる。これはある程度生得的な(生まれながらにして持っている)脳構造があるから。

自由意志にはこのような発達段階が重要と考えている。ではロボットに人間がそれだけの愛情を注げるかというと、私はできないと思う。ただ、ソニーの「aibo」に見られるように、ロボットに長く愛情を注ぐ人も出てきている。そういう人の愛情を受けて発達していけるロボットができたら、もっとすごいことになるのかもしれない。