昨年の11月半ばから今年の3月末までの4か月半に渡って「降雪予報」の期間でした。4月に入って新年度を迎えたのと同時に、このシーズンが終わりました。そこで、この1か月弱は「ニューロ・モデルの多層化」について研究を進めておりました。

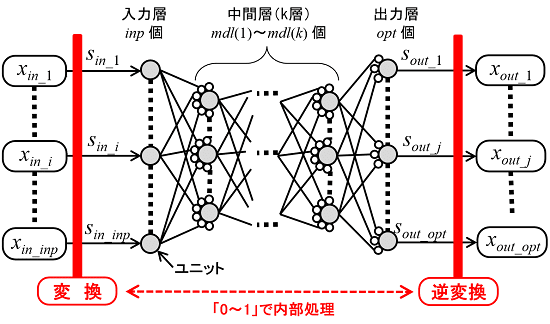

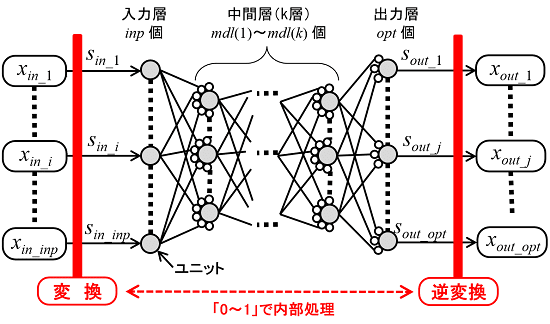

ニューロ・モデルの基礎である「ニューラルネットワーク」は、大きく分けて「入力層」「中間層(隠れ層)」「出力層」の3つから構成されます。入力層と出力層は1層ずつ設置されますが、中間層は1層以上を設置します。最も簡単な構造は、中間層を1層とした「3層構造」です。そして、中間層を多数設置したものを「ディープニューラルネットワーク」と言います。

そして、多層化されたニューロ・モデルの学習プロセスの一例です。この実験は、入力値とそれに対する正しい出力値(正解=教師データ)の組み合わせから成る「訓練データ」を反復学習させるものです。

入力値を与えると、それに対する出力値を計算します。その出力値と教師データ(正解)の誤差を評価して、モデル内のパラメータを出力側から入力側に向かって段階的に修正(調整)して行きます。このサイクルを何度も繰り返すことで、モデル全体として徐々に最適化が図られるものです。

実験の詳細は割愛しますが、横軸が反復回数、縦軸が予測誤差です。初めに誤差が低減した後、暫く横ばいの状態が続いています。その後、再び誤差が大きく低減する様子が描かれています。誤差が低減するということは、それだけ学習が進んでいることになります。

さて、私たち人間も、何らかの知識や技を習得するために、学習や練習を重ねます。しかし、その過程には多くの時間と労力を要し、途中で気持ちが萎えることもあるでしょう。どんなことでも、初めから上手くできる人はいないのです。

そして、それは人工知能にも同じことが言えます。その割には何かと「人工知能は凄い」と持て囃されます。それでは、人工知能は何が凄いのでしょうか。おそらく「膨大な数の反復練習を、物凄い速さでこなしてしまう」ことにある、と私は考えています。

周知の通り、機械は疲れや飽きを知りません。しかも、計算処理のスピードは人間のそれを遥かに凌駕しています。従って、「膨大な数の反復練習を、物凄い速さでこなしてしまう」ことが可能なのです。しかし、「初めから上手くできるわけではない」と言う点では人間と同じです。人間と同じようなプロセスと、人間よりも速く・大量にこなすことができるのです。

また、先のグラフからもわかるように、最初に誤差が低減した後、暫く横ばいの状態が続いています。それはまさに「いくら練習を重ねても、その効果が結果に現れて来ない」状態なのです。そして、その後の「ある段階」で一気に誤差が急落します。これはまさに「それまでの練習の効果が一気に現れた瞬間」と言っても良いでしょう。

問題は「その効果が現れて来ない」状態が何時まで続くのか、と言うことです。これは正直、わかりません。そして、上記の事は「人間の学習プロセス」についても言える事ではないでしょうか。

「いくら頑張っても、一向に結果につながらない」と言う経験は、多くの皆さんが共有していることでしょう。試験にせよ、仕事にせよ、「タイムリミット」が存在する以上、「所定の期間内に一定の効果を上げる」ことが求められます。そして、それができなければネガティブに評価されるのが、私たちの社会です。その意味では、「頑張っても芽が出ない」ものを「向いていない」として「損切り」するのも、場合によっては致し方ないでしょう。

しかしながら、「頑張った効果」それ自体は、しっかりと自分の中に蓄積されているということです。結果として目に見えるまでには至らなかったとしても、もしかしたら「もう少し頑張れば、一気に覚醒できた」のかも知れません。とは言え、それは誰にも判りません。

私が地域気象の研究を始めてから「一定の形」になるまでを考えても、ざっと10~20年は掛かっています。この間、ニューロ・モデルの研究も2~3回?途中で投げ出しています。それでも、過去に頑張った経験や感覚と言うものは、案外にも残っているものです。その積み重ねで漸くここまで到達できたのです。

努力の効果が必ずしも「結果」につながるとは限りません。しかし、自分の中には確実に「蓄積」されているのです。

ニューロ・モデルの基礎である「ニューラルネットワーク」は、大きく分けて「入力層」「中間層(隠れ層)」「出力層」の3つから構成されます。入力層と出力層は1層ずつ設置されますが、中間層は1層以上を設置します。最も簡単な構造は、中間層を1層とした「3層構造」です。そして、中間層を多数設置したものを「ディープニューラルネットワーク」と言います。

そして、多層化されたニューロ・モデルの学習プロセスの一例です。この実験は、入力値とそれに対する正しい出力値(正解=教師データ)の組み合わせから成る「訓練データ」を反復学習させるものです。

入力値を与えると、それに対する出力値を計算します。その出力値と教師データ(正解)の誤差を評価して、モデル内のパラメータを出力側から入力側に向かって段階的に修正(調整)して行きます。このサイクルを何度も繰り返すことで、モデル全体として徐々に最適化が図られるものです。

実験の詳細は割愛しますが、横軸が反復回数、縦軸が予測誤差です。初めに誤差が低減した後、暫く横ばいの状態が続いています。その後、再び誤差が大きく低減する様子が描かれています。誤差が低減するということは、それだけ学習が進んでいることになります。

さて、私たち人間も、何らかの知識や技を習得するために、学習や練習を重ねます。しかし、その過程には多くの時間と労力を要し、途中で気持ちが萎えることもあるでしょう。どんなことでも、初めから上手くできる人はいないのです。

そして、それは人工知能にも同じことが言えます。その割には何かと「人工知能は凄い」と持て囃されます。それでは、人工知能は何が凄いのでしょうか。おそらく「膨大な数の反復練習を、物凄い速さでこなしてしまう」ことにある、と私は考えています。

周知の通り、機械は疲れや飽きを知りません。しかも、計算処理のスピードは人間のそれを遥かに凌駕しています。従って、「膨大な数の反復練習を、物凄い速さでこなしてしまう」ことが可能なのです。しかし、「初めから上手くできるわけではない」と言う点では人間と同じです。人間と同じようなプロセスと、人間よりも速く・大量にこなすことができるのです。

また、先のグラフからもわかるように、最初に誤差が低減した後、暫く横ばいの状態が続いています。それはまさに「いくら練習を重ねても、その効果が結果に現れて来ない」状態なのです。そして、その後の「ある段階」で一気に誤差が急落します。これはまさに「それまでの練習の効果が一気に現れた瞬間」と言っても良いでしょう。

問題は「その効果が現れて来ない」状態が何時まで続くのか、と言うことです。これは正直、わかりません。そして、上記の事は「人間の学習プロセス」についても言える事ではないでしょうか。

「いくら頑張っても、一向に結果につながらない」と言う経験は、多くの皆さんが共有していることでしょう。試験にせよ、仕事にせよ、「タイムリミット」が存在する以上、「所定の期間内に一定の効果を上げる」ことが求められます。そして、それができなければネガティブに評価されるのが、私たちの社会です。その意味では、「頑張っても芽が出ない」ものを「向いていない」として「損切り」するのも、場合によっては致し方ないでしょう。

しかしながら、「頑張った効果」それ自体は、しっかりと自分の中に蓄積されているということです。結果として目に見えるまでには至らなかったとしても、もしかしたら「もう少し頑張れば、一気に覚醒できた」のかも知れません。とは言え、それは誰にも判りません。

私が地域気象の研究を始めてから「一定の形」になるまでを考えても、ざっと10~20年は掛かっています。この間、ニューロ・モデルの研究も2~3回?途中で投げ出しています。それでも、過去に頑張った経験や感覚と言うものは、案外にも残っているものです。その積み重ねで漸くここまで到達できたのです。

努力の効果が必ずしも「結果」につながるとは限りません。しかし、自分の中には確実に「蓄積」されているのです。